На следующей неделе отметит годовщину своего существования проект Нейрокомикс. За год в рамках этого проекта было опубликовано 53 материала, являющихся полностью дезинформационными, содержащими элементы языка ненависти, оскорбления иностранных государственных деятелей, политических оппонентов нынешнему режиму.

Проект начал публиковаться на страницах «Народной газеты» в апреле 2023 года, затем в конце июня переместился на страницы еженедельного выпуска «СБ Беларусь сегодня», который издается в полном цвете с заявляемым тиражом в 400 тысяч экземпляров.

Проект Нейрокомикс возник в партнерстве «Народной газеты» (государственной), токсичного телеграм-канала «Людажоры», а именно главного редактора «Народной газеты» Дмитрия Крят и публициста Юрия Тереха. Юрий Терех еще три года назад позиционировался, как блогер и предприниматель:

Медиахолдинг в июне 2023 рекомендовал региональным государственным изданиям использовать нейросети в своей работе.

Анализ всех заголовков публикаций Нейрокомикс на предмет дезинформационных нарративов показал:

- Сенсационизм и эмоциональная окраска: Заголовки содержат эмоционально окрашенные слова и фразы, например, «Трактовка мерзкого занятия», «не мое – не жалко», «оружейным бароном и наркобарыгой». Такой язык обычно используется для манипулирования чувствами читателя и привлечения внимания к статье.

- Оскорбления и стереотипы: Использование пренебрежительных терминов, таких как «цепные псы», «холоп», «наркобарыга», «дуэта прожженных лицемеров», может указывать на попытку дискредитации определенных лиц или групп.

- Теории заговора: Заголовки намекают на скрытые мотивы или секретные операции без предоставления доказательств, как в случае с «угрозой национальной безопасности» или «внешнего управления Штатами Украиной».

- Преувеличение и драматизация: Использование выражений типа «гильотина», «последнего украинца», «крутое пике» создает преувеличенный или драматизированный нарратив, который может искажать реальность.

- Манипулятивные утверждения: Заголовки, такие как «Есть ли жизнь после санкций для тех, кто их выдумал», представляют мнения как факты, что может вводить в заблуждение и искажать понимание реальных событий.

- Обвинения без доказательств: Заголовки предполагают факты вины, как в «как коррупционеры снюхались с коррупционерами», но не предоставляют подтверждения таких заявлений.

- Атака на личности: Указание на конкретных людей с негативным освещением, например «Макрон и его комплекс Бонапарта», может служить признаком попытки персональной дискредитации.

В целом, такие заголовки обычно призваны воздействовать на эмоции, предвзятость и мнения читателей, часто используя манипулятивные и дезинформационные техники, чтобы формировать определенное восприятие событий или людей.

Была выполнена тематическая категоризация публикаций по направлениям дезинформационных атак:

- Украина 12

- Беларуская оппозиция 11

- западные демократии 9

- Польша 7

- США 5

- Франция 4

- Литва 2

- Климатические изменения 2

По одной публикации про Сербию, Италию, Германию, Японию, Канаду, Молдову. Некоторые публикации затрагивали две темы одновременно.

Пример недавней публикации про Украину и лично Президента Украины — Владимира Зеленского:

Проанализируем сопроводительный текст данного комикса:

Анализ текста на наличие дезинформационных нарративов позволяет выделить несколько ключевых признаков, которые часто используются для манипуляции общественным мнением:

- Сенсационность и необычность утверждений: Упоминание о «белом порошке» на столе президента Зеленского и его связи с «наркомафией» направлено на привлечение внимания и создание сенсационного впечатления. Это прием часто используется в дезинформационных кампаниях для усиления эмоционального воздействия на читателя.

- Отсутствие достоверных источников: Хотя упоминается, что статья основана на «эпичном журналистском расследовании», конкретных доказательств или ссылок на надежные источники в тексте не приводится. Фраза «достаточно убедительные доказательства» не подкрепляется фактическим содержанием или ссылками, что вызывает сомнения в достоверности информации.

- Использование загруженной лексики и эмоциональных выражений: Описания, такие как «забористый оборот», «сомнительные вещества», и «дело века» призваны усилить эмоциональное восприятие сообщения и могут вводить читателя в заблуждение относительно реальности изложенных фактов.

- Анонимность и непроверенные утверждения: Упоминание перехваченных Интерполом телефонных переговоров, без предоставления дополнительных деталей или возможности верификации, также является признаком потенциальной дезинформации.

- Предвзятость и стереотипы: Фраза «в наших широтах, где давно знают, что от господина Зе можно ожидать чего угодно» указывает на использование предвзятых суждений и стереотипов для формирования мнения читателя, что является распространенным методом дезинформации.

- Теории заговора и спекуляции: Привлечение внимания к «нейросети», которая предложила «свою версию сделки века», добавляет элемент теории заговора, подогревая интерес и спекуляции без предоставления реальных доказательств.

Эти элементы сигнализируют о потенциальной дезинформации в тексте и требуют критического анализа и дополнительной проверки перед тем, как делать какие-либо выводы или распространять информацию дальше.

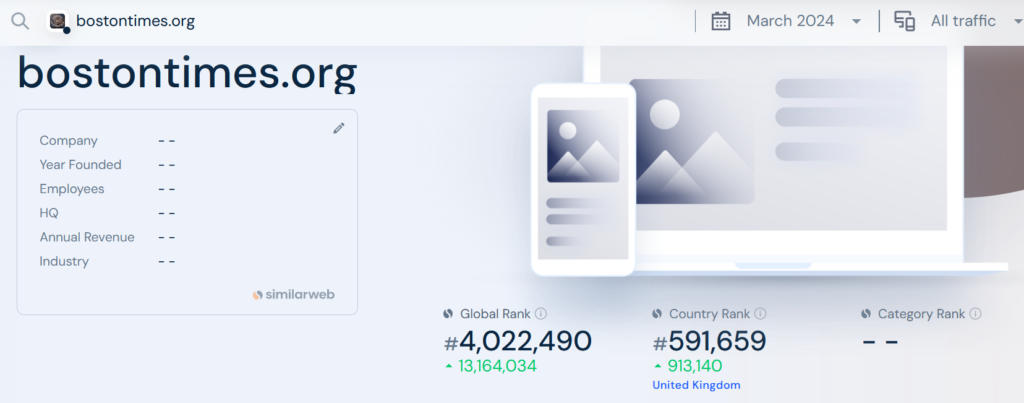

В сопроводительном тексте есть ссылка на издание The Boston Times. Здесь используется ловкий прием, что известное издание похожее по звучанию — это The Boston Globe.

Разница в трафике и соответственно популярность медийных ресурсов показана на данных SimilarWeb. Неизвестность издания нисколько не смущает российское издание «Международная жизнь» / The International Affairs с публикацией: ‘The Boston Times’: Zelensky’s flight under scrutiny amid allegations of cocaine smuggling during Milei’s inauguration

Еще более свежий «нейрокомикс» от 6 апреля 2024 под заголовком: Коротко об отношении к молдавским детям молдавских же и европейских властей: не мое – не жалко

Проанализируем данный текст на дезинформационные нарративы:

Текст содержит несколько ярких признаков дезинформационных нарративов, которые могут быть использованы для манипулирования общественным мнением:

- Эмоционально окрашенные выражения и загруженная лексика: Фразы вроде «ЕС руками стран — своих цепных псов» и «хозяин, а кто холоп» используются для создания негативного образа Европейского Союза и его стран-членов. Такой язык призван вызвать эмоциональную реакцию у читателя и склонить его к определённой точке зрения.

- Презентация информации без контекста или доказательств: Утверждение о том, что поляки и литовцы не пустили детский хор на свою территорию, объявив их «угрозой национальной безопасности», представлено без каких-либо подтверждающих деталей или объяснения контекста. Это может ввести читателя в заблуждение относительно истинной природы события.

- Создание теорий заговора: Фраза «огрызаться на хозяина страшно» предполагает наличие некоего заговора или подавления со стороны ЕС, что усиливает восприятие Евросоюза как деспотической или доминирующей силы.

- Использование стереотипов и демонизация: Описание обращения с детьми на границе создано для усиления негативного восприятия соседних стран, что может подпитывать антиевропейские настроения.

- Отсутствие реакции от официальных лиц: Упоминание о том, что МИД Молдавии и политическая верхушка не реагировали на инцидент, представляет их в неблагоприятном свете, что может быть направлено на подрыв доверия к национальному правительству.

- Использование технологий для усиления нарратива: Фраза «нейросеть смоделировала, к чему может привести такое наплевательское отношение к собственному народу» использует элементы современных технологий для добавления веса и авторитетности утверждениям, несмотря на отсутствие деталей о методологии или результатах такого моделирования.

Таким образом, этот текст использует ряд техник дезинформации для формирования определённого образа событий и воздействия на общественное мнение, что требует критического подхода при его анализе и интерпретации.

С помощью инструмента WeVerify проанализировали все возможные искажения в образе Президента Республика Молдовы, которая выглядит на самом деле:

Как видно, что эта публикация направлена на создание негативного образа, как Молдовы, Польской Республики и Европейского Союза в целом. Дополнительно демонстрирует противоправные действия.

Подводя итоги можно отметить, что исследуемый проект является полноценным примером использования удивительных возможностей искусственного интеллекта для полномасштабной генерации дезинформационных публикаций и изображений.

Комментарии закрыты.